Ethical AI

Slide 02

الذكاء الاصطناعي الأخلاقي (Ethical AI) 😇⚖️

مش بس بدنا موديل "شاطر" وبطلع نتائج دقيقة، بدنا موديل "متربي" وبمشي على مبادئ أخلاقية.

شو يعني Ethical AI؟

هو تصميم أنظمة ذكاء اصطناعي بتلتزم بمبادئ مثل:

- Fairness (العدالة): ما يظلم فئة على حساب ثانية.

- Transparency (الشفافية): نفهم كيف الموديل باخذ قراراته.

- Accountability (المسؤولية): مين المسؤول لو الموديل غلط؟

الأخلاقي vs التقليدي:

الذكاء الاصطناعي التقليدي كان كل همه الـ Performance (الدقة

والسرعة)، أما الأخلاقي بضيف عليهم "المسؤولية الاجتماعية" (Social

Responsibility).

What is Bias in AI?

Slide 03

شو يعني انحياز (Bias) في الـ AI؟ 🚨🎯

الـ Bias هو "غلطة سيستماتيكية" بالسيستم بتخلي النتائج دائماً مايلة

لجهة معينة وغير عادلة.

أنواع الانحياز:

- Data Bias: لما الداتا اللي دربنا عليها الموديل تكون مش متوازنة (مثلاً: صور قطط بيضا بس، فالموديل ببطل يعرف القطط السودا).

- Algorithmic Bias: لما الخوارزمية نفسها تبرمجت بطريقة فيها انحياز.

- Human Bias: انحيازنا إحنا كبشر بننقله للموديل بدون ما نحس (أثناء جمع الداتا أو تقييمها).

أمثلة بتخوف:

انحياز في التوظيف (بفضل البنات عالرجال ) أو انحياز في التعرف على الوجوه (بفشل مع أصحاب

البشرة

السوداء).

Machine Bias Examples

Slide 04

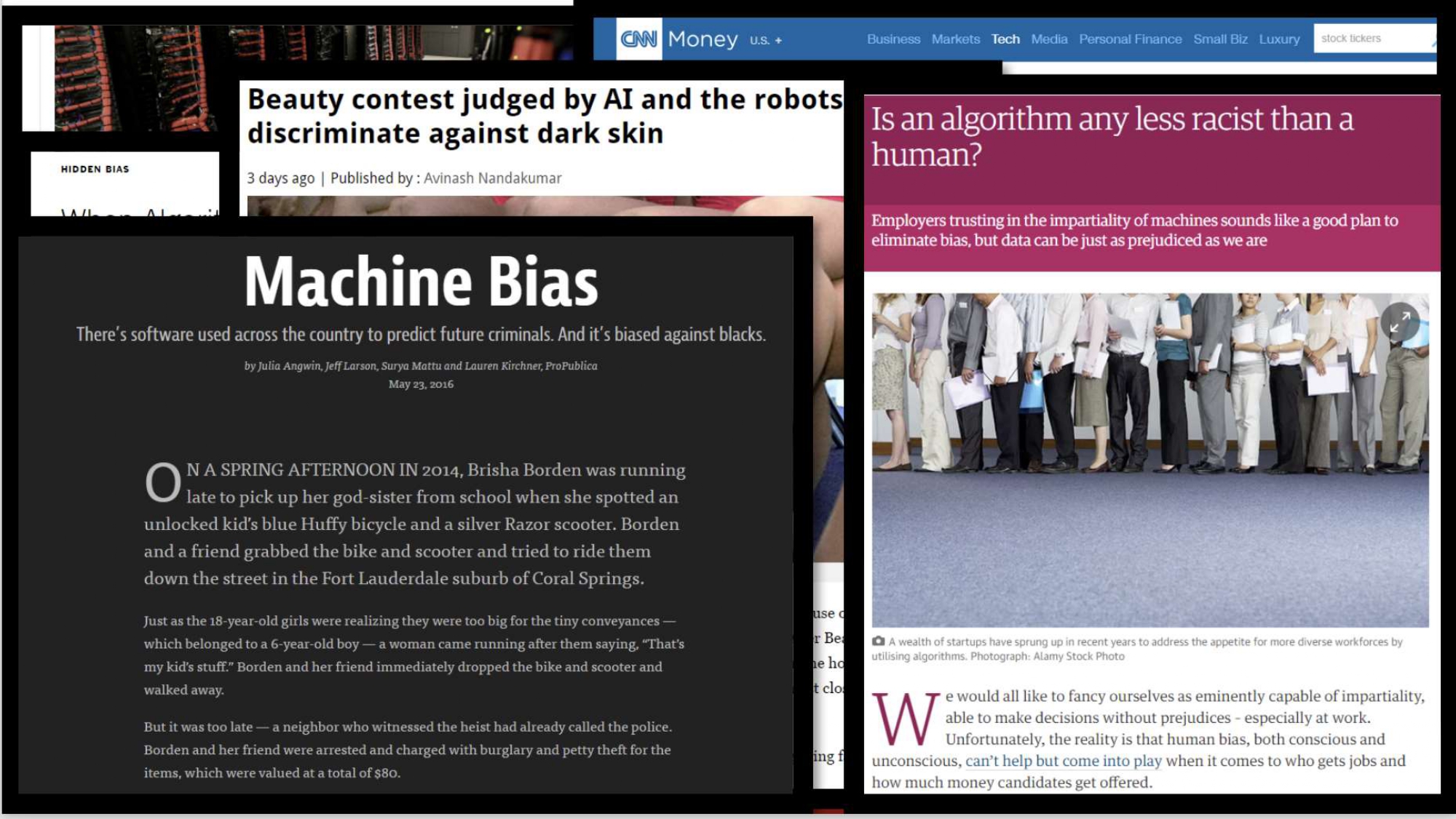

فضائح عالمية للانحياز 📰⚠️

الـ Bias مش بس حكي نظري، هاي أمثلة حقيقية هزت العالم:

مسابقات جمال ظالمة: ذكاء اصطناعي حكم في مسابقة جمال وكان

"عنصري" ضد البشرة السوداء لأن الداتا اللي شافها أغلبها لأصحاب بشرة فاتحة.

توقع الإجرام (Machine Bias): برنامج مشهور بأمريكا كان يتوقع

"مين رح يرجع يسجن" وكان دائماً بعطي تقييم خطر عالي للسود حتى لو سجلهم نظيف، وتقييم منخفض

للبيض حتى لو سجلهم مليان!

👨🏫 الزبدة: الموديل "ببغاء"، إذا الداتا فيها عنصرية رح

يطلع موديل عنصري.

Real-world Bias Cases

Slide 05

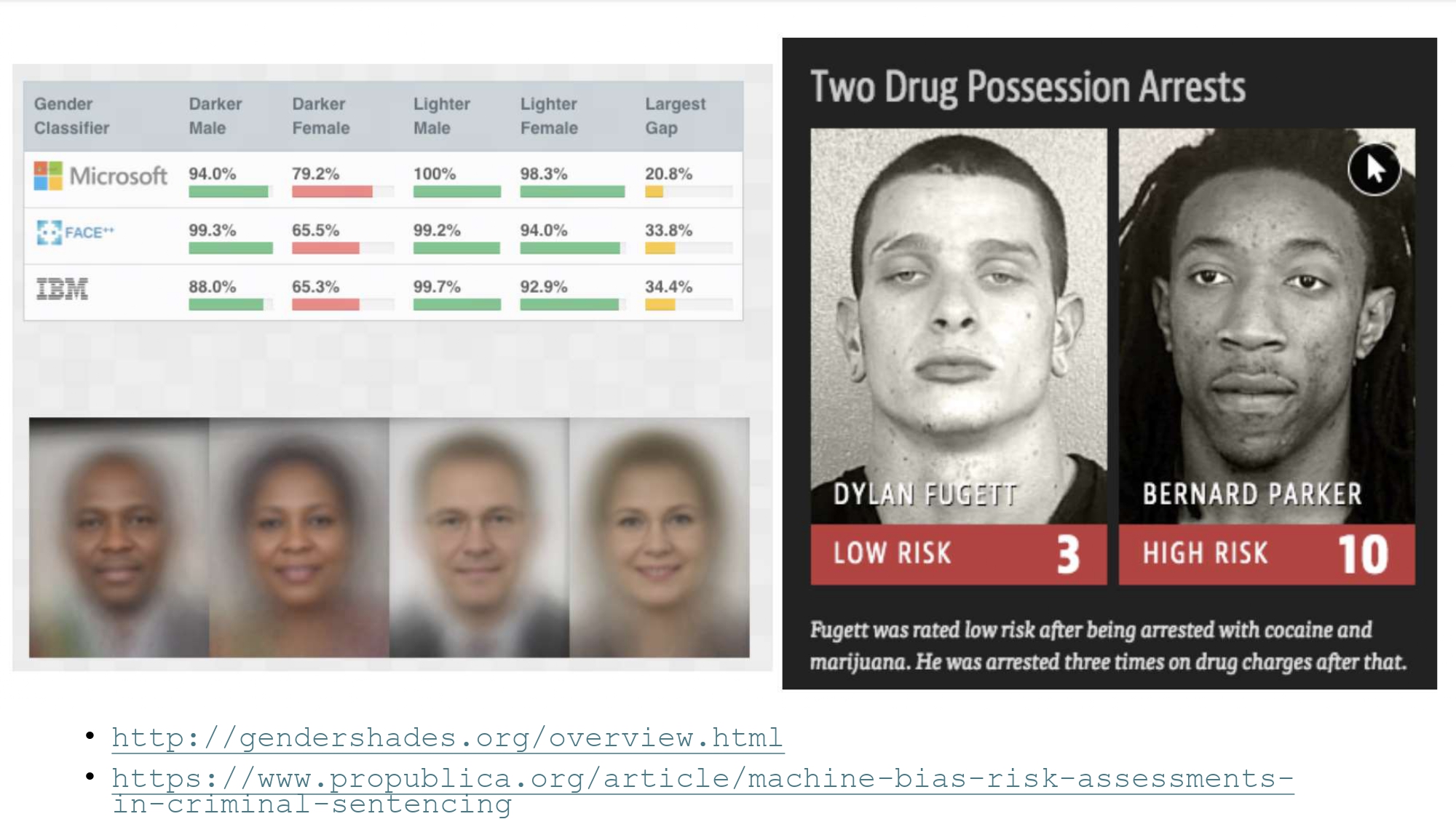

بالأرقام والدلائل 📊📉

هون بنشوف دراسات حقيقية كشفت بلاوي:

Gender Shades Study: دراسة كشفت إن برامج التعرف على الوجوه

من (IBM, Microsoft, Face++) دقتها عند النساء صاحبات البشرة الداكنة بتنزل للـ 65%، بينما عند

الرجال البيض بتوصل لـ 99%!

قضية COMPAS: المثال اللي بالصورة (Dylan vs Bernard) بفرجينا

كيف الموديل صنف شخص أبيض (سوابق كثيرة) كـ "خطر منخفض"، وشخص أسود (سوابق بسيطة) كـ "خطر عالي

جداً 10/10".

Why Does Bias Matter?

Slide 06

ليش لازم نهتم بالانحياز؟ 🧩🤔

الموضوع مش بس "مثالية"، الموضوع اله أبعاد خطيرة على المجتمع والشركات:

1. التأثير على المجتمع:

الـ Bias بعزز عدم المساواة الموجودة أصلاً، وبخلي فئات معينة

تنظلم بشكل متكرر في التعليم، الصحة، أو حتى القضاء.

2. التأثير على الشركات:

الشركات اللي بتستخدم موديلات منحازة بتخسر سمعتها وثقة الناس فيها، وممكن تتعرض لمساءلات

قانونية وغرامات بالملايين.

✅ أمثلة: أداة التوظيف في Amazon

اللي كانت ترفض النساء، وخوارزمية COMPAS في القضاء.

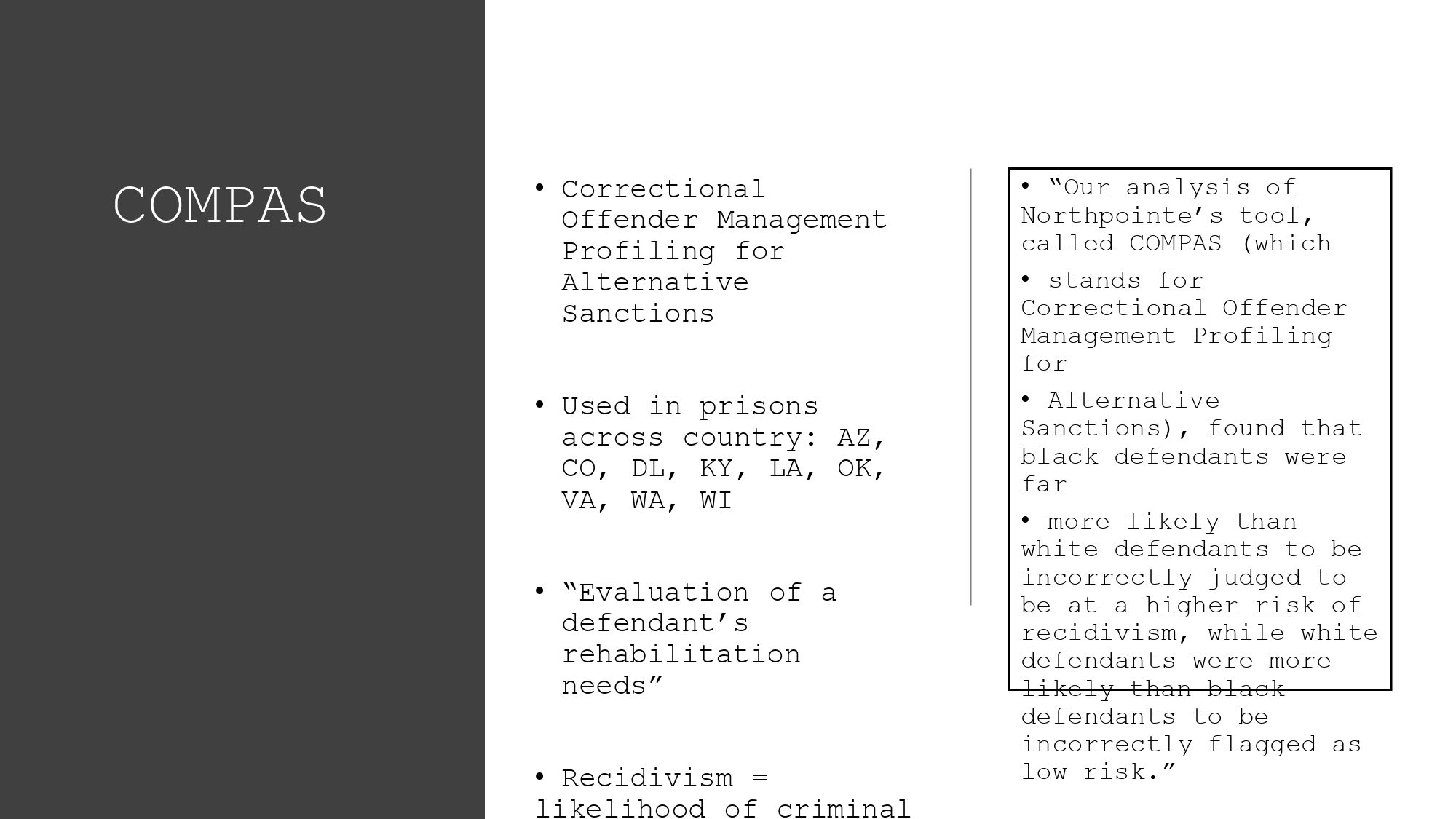

COMPAS Algorithm

Slide 07

خوارزمية COMPAS: صرخة في وجه العدالة ⚖️📢

هاي الخوارزمية بتستخدمها السجون في أمريكا عشان تتوقع احتمال رجوع المجرم للجريمة (Recidivism).

شو اكتشفت ProPublica؟

بعد تحليل للأداة، طلع إنها بتظلم السود بشكل مضاعف:

- المتهمين السود كان دائماً يتم تصنيفهم كـ "خطر عالي" بالخطأ.

- المتهمين البيض كان يتم تصنيفهم كـ "خطر منخفض" بالخطأ أكثر من السود.

هاذ المثال بفرجينا كيف "الأرقام" ممكن تكون عنصرية لو الداتا اللي انبنت عليها كانت منحازة

تاريخياً.

Detecting Bias in ML Models

Slide 08

كيف نكشف الـ Bias؟ 🔍🕵️♂️

عشان نعرف إذا الموديل "بخبص" ولا لأ، لازم نستخدم تقنيات وأدوات مخصصة:

التقنيات (Techniques):

- Disparate Impact Analysis: بنقارن نسبة النتائج الإيجابية بين المجموعات المختلفة.

- مقاييس العدالة (Fairness Metrics): مثل Demographic Parity.

الأدوات (Tools):

الشركات الكبيرة عاملة مكتبات جاهزة لمساعدتنا، مثل:

- AI Fairness 360 من IBM.

- Fairlearn من Microsoft.

Mitigating Bias in ML

Slide 09

كيف نعالج الـ Bias؟ (عمليات العلاج) 💉🩹

العلاج بصير على 3 مراحل حسب وين المشكلة:

1. Pre-Processing: تنظيف الداتا قبل التدريب (مثلاً: نوازن

عدد العينات لكل فئة).

2. In-Processing: نعدل على الخوارزمية نفسها وهي بتتدرب عشان

"نجبرها" تكون عادلة.

3. Post-Processing: بعد ما الموديل يطلع النتيجة، بنعدلها

شوي عشان نضمن العدالة النهائية.

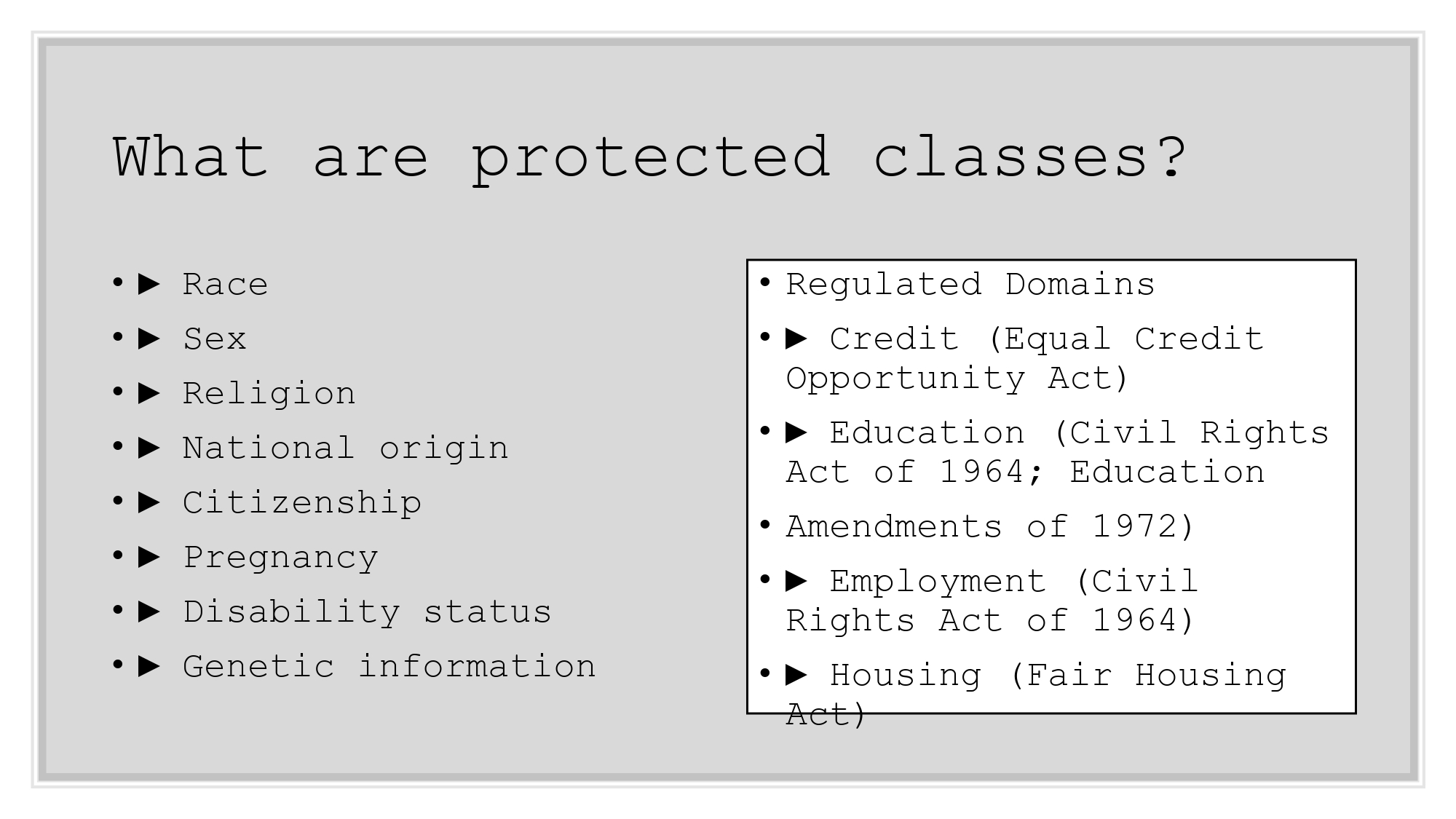

Protected Classes

Slide 10

الفئات المحمية (Protected Classes) 🛡️👤

فيه ميزات (Features) "خط أحمر" ممنوع الموديل يستخدمها عشان يميّز بين الناس قانونياً:

⚖️ المجالات المنظمة: القروض، التعليم، التوظيف، والسكن. هون

القانون بكون صارم جداً بمنع أي تمييز بناءً على هاي الفئات.

- العرق (Race) والجنس (Sex).

- الدين (Religion) والأصل القومي.

- الحالة الصحية، الحمل، والمعلومات الجينية.

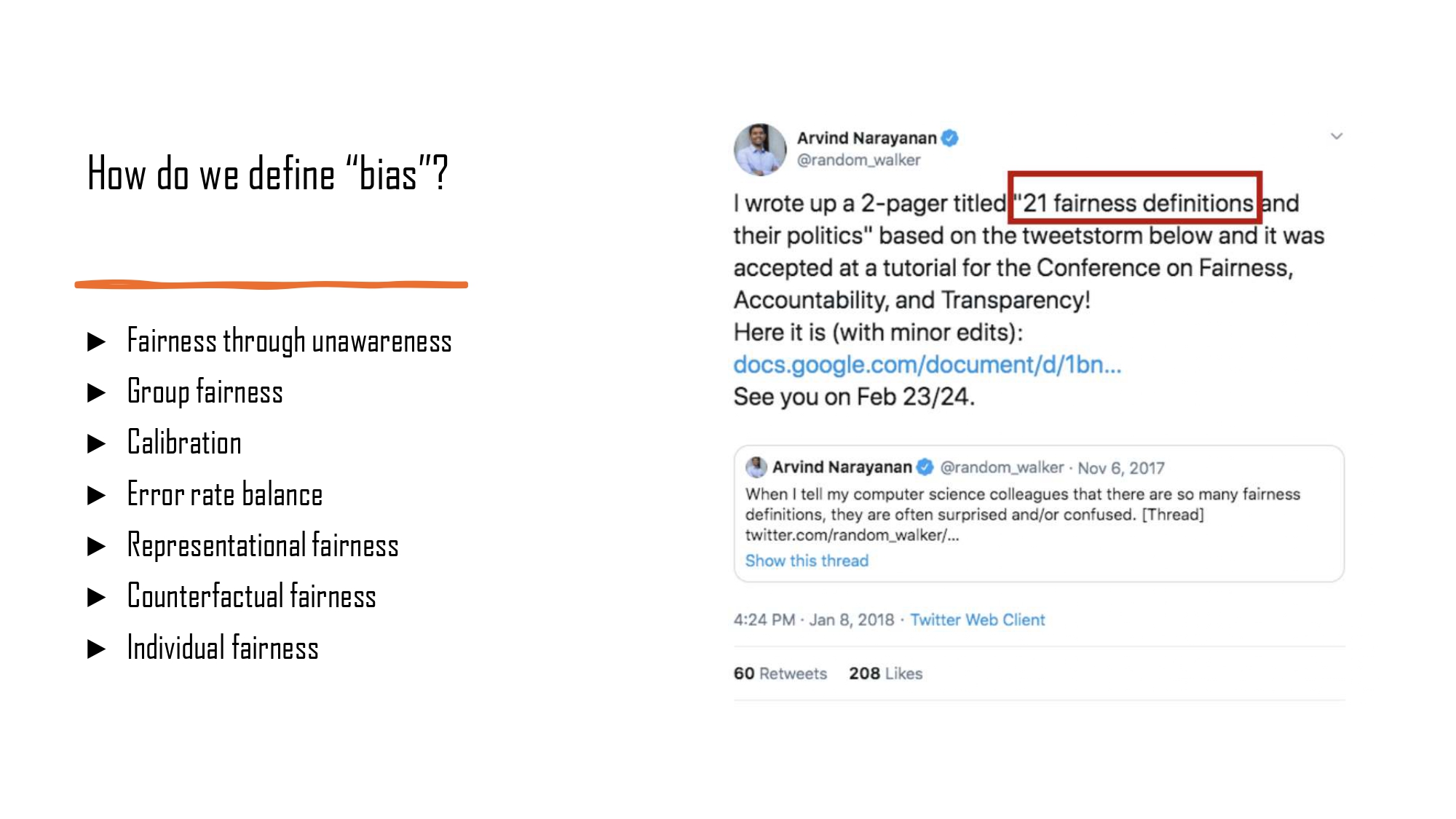

How do we define bias?

Slide 11

تعريفات العدالة (مش تعريف واحد!) 🤯📚

تخيل إنه فيه أكثر من 21 تعريف للعدالة في علم البيانات! كل واحد بشوف العدالة من زاوية:

🤯 المشكلة: مستحيل حسابياً تحقق كل هاي التعريفات مع بعض في نفس

الموديل! لازم تضحي بوحدة عشان الثانية.

- Individual Fairness: معاملة الأشخاص المتشابهين بشكل متشابه.

- Group Fairness: مجموعات الناس (ذكور/إناث مثلاً) ياخذوا نفس نسبة النتائج.

- Representational Fairness: هل الداتا بتمثل كل أطياف المجتمع صح؟

Fairness & Transparency

Slide 12

العدالة والشفافية (Fairness & Transparency) 🕯️⚖️

العدالة ما بتكمل بدون شفافية. لازم نعرف "ليش" الموديل قرر هيك.

الهدف:

👨⚖️ السؤال الجوهري: لو الموديل رفض قرض لشخص، هل بنقدر نبرر

السبب بشكل منطقي بعيد عن الانحياز?

- تقليل الانحياز في اتخاذ القرارات.

- تجنب التمييز المبني على العرق أو الجنس.

- ضمان المساءلة (Accountability).

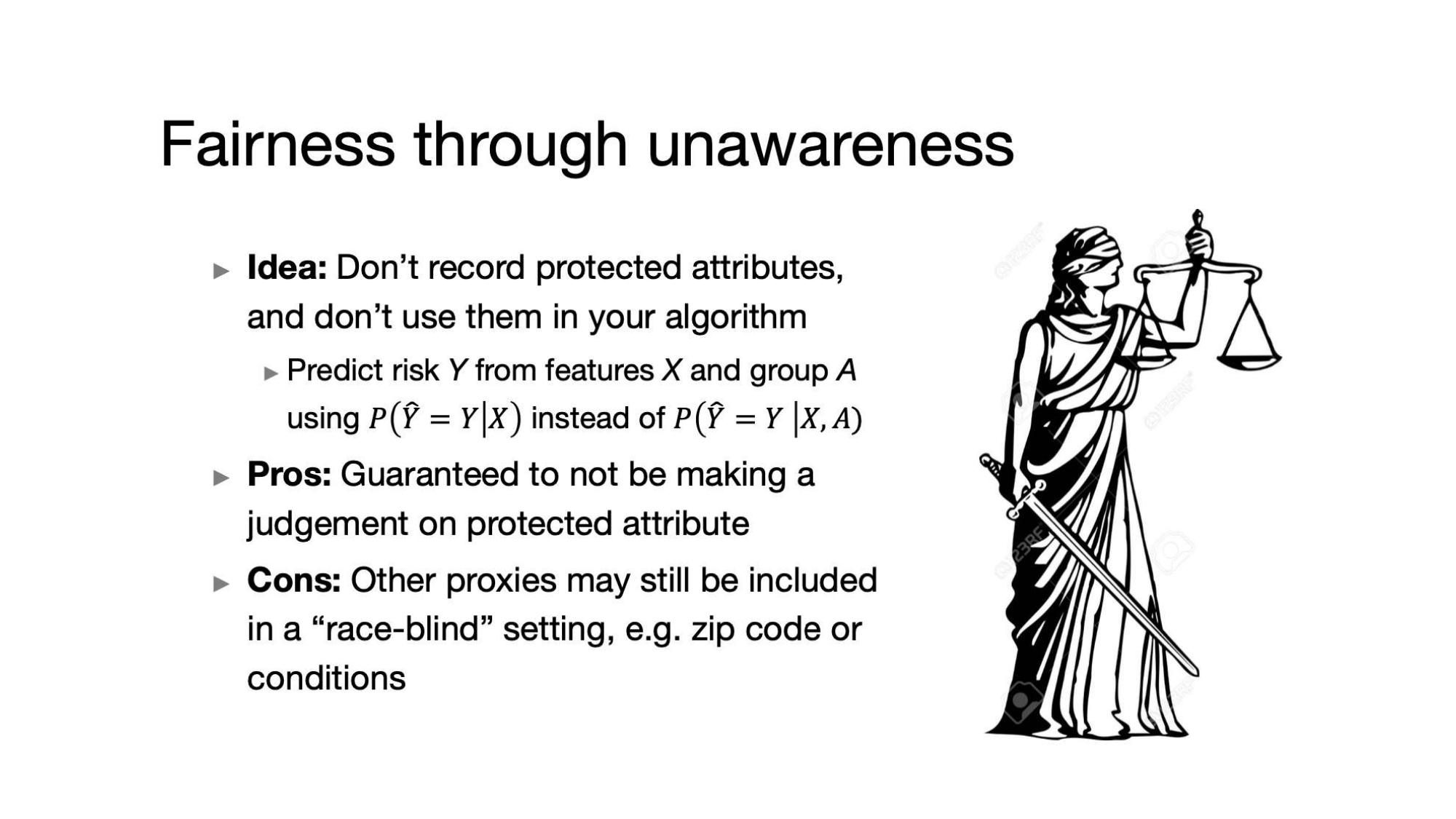

Fairness through unawareness

Slide 13

العدالة عبر "التعامي" (Unawareness) 🙈⚖️

هاي أبسط فكرة (وأخطرها بنفس الوقت): "لو شلنا العرق والجنس من الداتا، الموديل رح يصير عادل غصب

عنه".

الإيجابيات: بنضمن 100% إنه الموديل ما شاف الميزة المحمية

بشكل مباشر.

السلبيات (المصيبة): فيه شي اسمه Proxies. مثلاً, الـ Zip Code

(الرمز البريدي) في بعض البلدان ممكن يدل بقوة على العرق، فإنت كأنك دخلت العرق من "الباب

الخلفي".

⚠️ الخلاصة: مجرد حذف الميزة مش كافي أبداً لتحقيق العدالة.

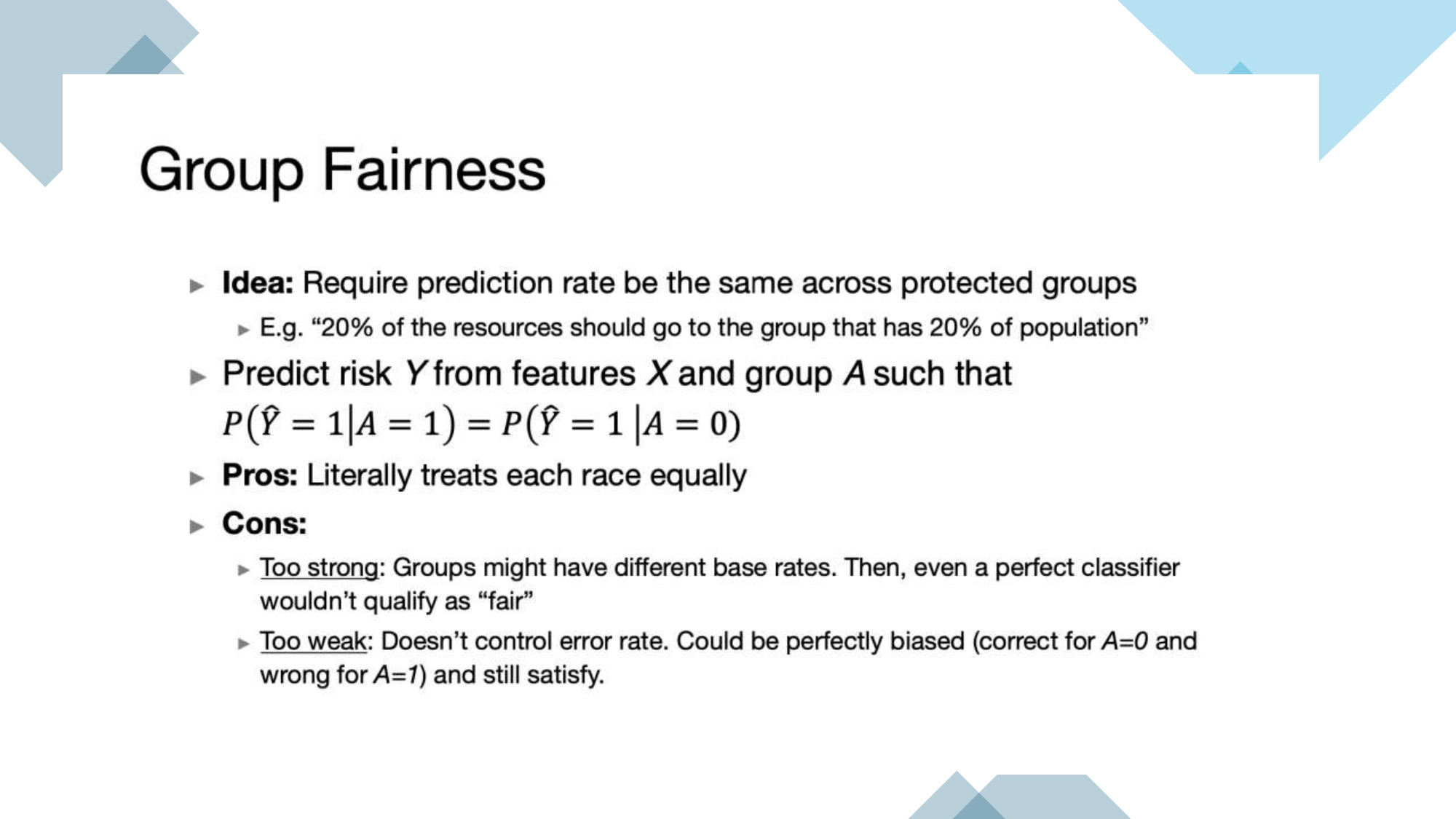

Group Fairness

Slide 14

عدالة المجموعات (Group Fairness) 🤝📊

الفكرة هون إنه "النتائج" لازم تتوزع على المجموعات بنسب متساوية بناءً على تمثيلهم في المجتمع.

المبدأ: لو فئة معينة بتشكل 20% من السكان، لازم تاخذ 20% من

الفرص (قروض، وظائف، إلخ).

الإيجابيات والسلبيات:

- ممتاز: لأنه بضمن مساواة حقيقية في النتائج النهائية.

- مشكلته: ممكن يكون "قوي زيادة"، لأنه أحياناً المجموعات بكون إلها نسب أساسية مختلفة (Base Rates)، فالموديل بضطر يظلم ناس شاطرة عشان يوازن الأرقام.

Fairness Metrics in ML

Slide 15

مقاييس العدالة (Metrics) 📏⚖️

كيف "نحسب" إذا الموديل عادل؟ فيه 3 مقاييس رئيسية بنستخدمها:

- Demographic Parity: المجموعات تاخذ نتائج إيجابية بنفس النسبة بغض النظر عن مؤهلاتهم.

- Equal Opportunity: المجموعات تاخذ نفس نسبة "النتائج الصح" (يعني لو فيه ناس بتستحق القرض، لازم نسبة المقبولين تكون متساوية بين المجموعات).

- Equalized Odds: بنوازن بين الـ True Positive والـ False Positive لكل المجموعات.

Methods for Ensuring Fairness

Slide 16

طرق ضمان العدالة 🛠️✅

عشان نضمن عدالة الموديل، التدخل بصير في 3 محطات رئيسية:

1. معالجة الداتا (Pre-processing): بنعدل الداتا قبل ما

الموديل يشوفها عشان نشيل أي انحياز تاريخي.

2. تعديل الخوارزمية (Algorithmic adjustments): بنضيف "شروط

عدالة" داخل الموديل وأنا بدربه (In-processing).

3. تصحيح النتائج (Post-processing): بعد ما الموديل يطلع

قراره، بنعمل تعديل بسيط عشان نحقق أهداف العدالة المطلوبة.

Importance of Transparency

Slide 17

أهمية الشفافية (Transparency) 🕯️🔍

الشفافية مش "رفاهية"، هي أساس الثقة بين الموديل والمستخدم.

ليش الشفافية مهمة؟

👨🏫 الزبدة: الموديل اللي بشتغل كـ "صندوق أسود" (Black Box) ما حدا برتاح اله، لازم نضوّي الضو على كيف بفكر.

- بتسمح للمستخدمين يفهموا "ليش" الموديل اتخذ قرار معين.

- بتقلل من سوء الفهم ونشر المعلومات الغلط.

- بتزيد الثقة في أنظمة الذكاء الاصطناعي.

Explainable AI (XAI)

Slide 18

الذكاء الاصطناعي القابل للتفسير (XAI) 🔎💡

الـ Explainable AI هو العلم اللي بحول الموديلات المعقدة لأشياء

بنقدر نفهمها كبشر.

أهم الأدوات العالمية:

🎯 الهدف: تحويل الـ Black Box لـ

Glass Box (صندوق زجاجي) بنشوف كل اللي جواته.

- SHAP: بفرجينا وزن كل ميزة (Feature) في القرار النهائي.

- LIME: بيشرح قرارات الموديل "محلياً" لكل حالة لحالها.

Ethical AI Regulations

Slide 19

القوانين والتشريعات الأخلاقية 📜⚖️

العالم انتبه لخطورة الـ AI وبدأ يحط قوانين صارمة لحماية الناس:

أهم التشريعات العالمية:

- GDPR: قانون حماية البيانات الأوروبي (بأثر على كل العالم).

- EU AI Act: أول قانون شامل في العالم لتنظيم الذكاء الاصطناعي حسب درجة خطورته.

- U.S. AI Bill of Rights: مبادئ أمريكية لحماية الحقوق المدنية من تغول الـ AI.

Role of Governments

Slide 20

دور الحكومات في أخلاقيات الـ AI 🏛️🛂

الحكومات مش بس "متفرج"، إلها دور تنفيذي ورقابي كبير:

- وضع القوانين: تشريع قوانين بتجبر الشركات تكون عادلة.

- المساءلة (Accountability): محاسبة الشركات اللي بتستخدم موديلات بتسبب ضرر أو تمييز.

- مراقبة الاستخدام: منع استخدام الـ AI في مجالات بتمس كرامة الإنسان بدون رقابة.

Ethical Frameworks for AI

Slide 21

أطر العمل الأخلاقية (Frameworks) 🧱🧠

عشان نطبق الأخلاقيات صح، فيه أطر عمل عالمية بتوجهنا:

المبادئ الأساسية: العدالة، المسؤولية، الشفافية، والخصوصية.

أمثلة وتحديات:

- أمثلة: دليل IEEE للتصميم الأخلاقي، وإرشادات الاتحاد الأوروبي للذكاء الاصطناعي الموثوق.

- التحديات: أصعب شي هو "الموازنة" بين المبادئ (مثلاً: أحياناً الدقة بتتعارض مع الخصوصية)، وكيف نحول هاي النظريات لأكواد برمجية حقيقية.

GDPR (General Data Protection Regulation)

Slide 22

قانون حماية البيانات الأوروبي (GDPR) 🇪🇺🔐

هاذ "البعبع" تبع شركات التكنولوجيا في أوروبا، وهو أقوى قانون حماية بيانات في العالم.

المبادئ الأساسية:

تقليل الداتا (ما نجمع شي زيادة)، الموافقة الصريحة، وحق "النسيان" (من حقك تطلب حذف بياناتك).

أثره على الـ AI:

بجبر الشركات تكون شفافة وتحكي للناس كيف بتستخدم بياناتهم في تدريب الموديلات، وبتعطيهم الحق

يعترضوا على القرارات المؤتمتة.

CCPA (California Consumer Privacy Act)

Slide 23

قانون خصوصية المستهلك في كاليفورنيا (CCPA) 🇺🇸🏙️

كاليفورنيا عملت قانونها الخاص، وبشبه الـ GDPR لدرجة كبيرة، وبأثر على أي شركة بتتعامل مع سكان

الولاية.

الحقوق الممنوحة:

حق المعرفة (شو بتعرفوا عني؟)، حق الحذف، وحق الاعتراض على "بيع" البيانات الشخصية.

أهميته العالمية:

بما إنه أغلب شركات التكنولوجيا العملاقة (Google, Apple, Meta)مقرها في كاليفورنيا، فهاض

القانون بيأثر على سياساتهم اللي بتطبق علينا كلنا.

Ethical Dilemmas in AI

Slide 24

المعضلات الأخلاقية (Ethical Dilemmas) 🤯🛤️

هون بندخل في "الحيط" فلسفياً؛ الـ AI بواجِه مواقف ما إلها جواب واحد صح، والقرار فيها اله تبعات

أخلاقية.

أمثلة صعبة:

🎯 السؤال الجوهري: مين المسؤول لو الموديل اتخذ قرار "أخلاقي"

غلط؟ المبرمج ولا الشركة ولا السيستم نفسه؟

- معضلة العربة (Trolley Problem): السيارات ذاتية القيادة لو صار حادث محتوم، تضحي بمين؟ السائق ولا المشاة؟ وهل حياة طفل أهم من حياة شخص مسن؟

- المراقبة (Surveillance): هل مسموح نستخدم الـ AI في التعرف على الوجوه في كل مكان بحجة "الأمن"؟ وين بتخلص حريتنا وبتبدأ الرقابة؟

Privacy-Preserving Techniques

Slide 25

مخاطر انتهاك الخصوصية 🛑👤

لو الداتا وقعت في الإيد الغلط، العواقب بتبطل مجرد أرقام، بتصير كارثية على أرض الواقع.

المخاطر المحتملة: سرقة الهوية، الخسائر المالية، وحتى تدمير

السمعة الاجتماعية.

تذكروا فضيحة Cambridge Analytica: كيف تم استخدام داتا

ملايين المستخدمين بدون علمهم عشان يحللوا شخصياتهم ويأثروا على قراراتهم السياسية.

🔐 الحل: صار لازم نستخدم تقنيات بتسمح للموديل يتدرب "بدون ما

يشوف" الداتا الحساسة بشكل مباشر.

Differential Privacy

Slide 26

الخصوصية التفاضلية (Differential Privacy) 📉🎭

كيف نطلع إحصائيات مفيدة من مجموعة ناس بدون ما نقدر نعرف "مين" عمل "شو"؟

الفكرة: بنضيف "نويز" (Noise) أو ضوضاء رياضية مدروسة للداتا.

النتيجة العامة بتضل صحيحة، بس مستحيل تقدر ترجع لبيانات أي شخص لوحده.

وين بنشوفها؟

بتستخدمها (Apple) عشان تعرف شو أكثر "إيموجي" الناس بتستخدمه بدون ما تقرأ مسجاتهم، وجوجل في

تحليل حركة السير في الخرائط.

Federated Learning

Slide 27

التعلم الاتحادي (Federated Learning) 📱🤝

بدل ما نبعث الداتا للسيرفر عشان ندرّب الموديل، بنبعث الموديل هو اللي يروح عند الداتا!

الآلية: موبايلك بيتدرب على صورك أو كتاباتك "محلياً"، وبعدين

ببعث بس "شو تعلم" (Weights) للسيرفر. صورك ومسجاتك عمرها ما بتطلع من جهازك.

المميزات: حماية قصوى للخصوصية، توفير في استهلاك الإنترنت،

وسرعة في التحديث.

🧤 مثال: ميزة التصحيح التلقائي في الكيبورد بتتعلم كلماتك الخاصة

بهي الطريقة.

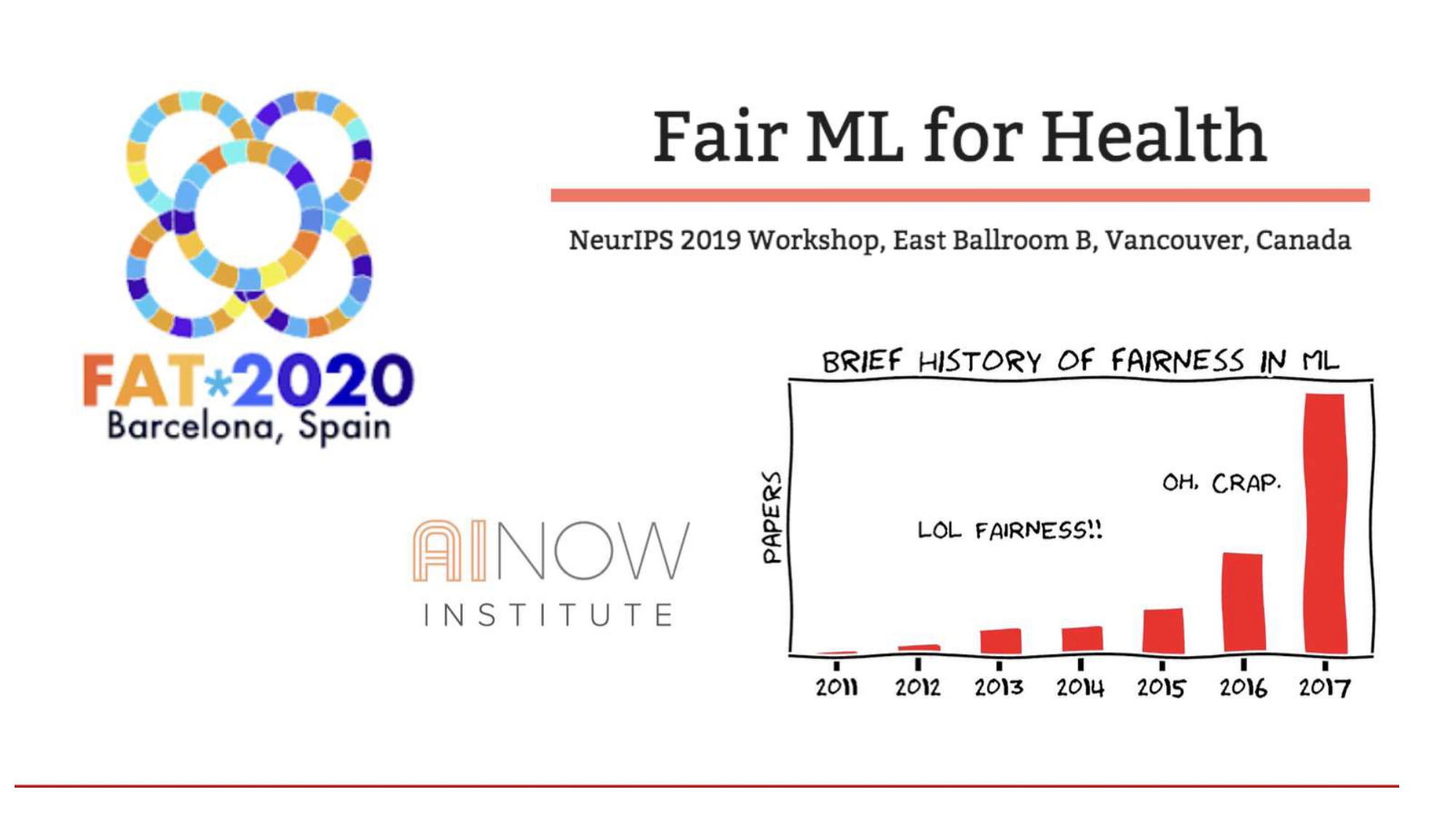

Fair ML for Health

Slide 28

رحلة الـ Fairness عبر الزمن 📈⏳

موضوع العدالة مش مجرد "تريند" عابر، هو علم قاعد بيكبر بسرعة الصاروخ.

انفجار الأبحاث: زي ما فرجانا السلايد، من سنة 2011 لسنة

2017، عدد الأبحاث اللي بتحكي عن الـ Fairness زاد بشكل خيالي (من "ضحك ومزح" لـ "يا

مصيبتنا!").

العدالة في الصحة (ML for Health): واحد من أخطر المجالات،

لأنه لو الموديل كان منحاز في تشخيص الأمراض، هاض معناه "حياة أو موت" لفئات معينة.

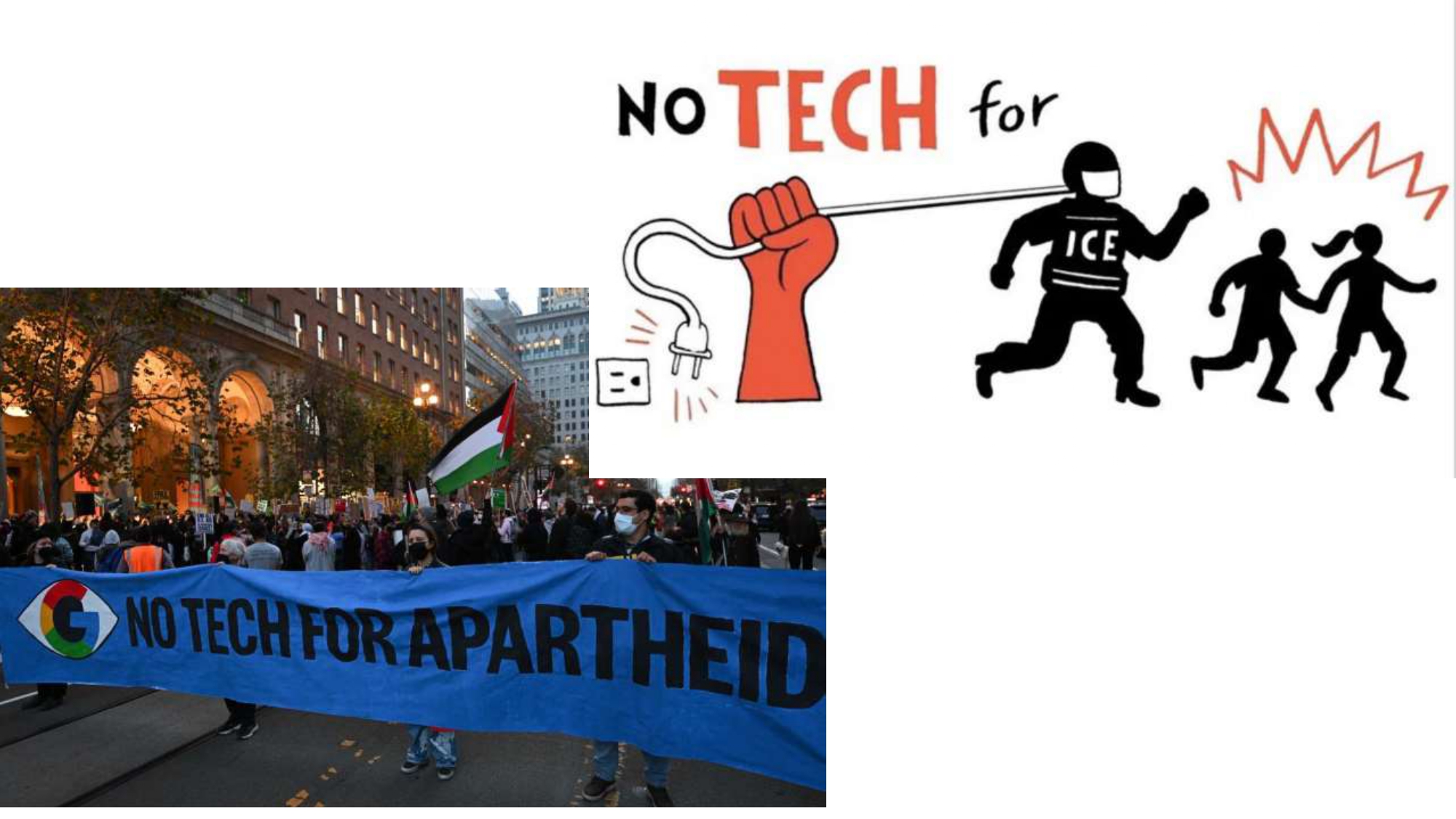

No TECH for APARTHEID

Slide 29

التكنولوجيا والنشاط الاجتماعي 🚫✊

المهندسين والمبرمجين مش "آلات"، صار عندهم وعي أخلاقي ورفضوا إن شغلهم يستخدم في القمع أو الفصل

العنصري.

حملات عالمية: مثل حملة "No Tech for Apartheid" اللي قادوها

موظفي جوجل وأمازون احتجاجاً على مشروع (Nimbus).

الرسالة: العلم والتقنية لازم يكونوا في خدمة الإنسانية، مش

أداة للمراقبة والسيطرة على الشعوب المظلومة.

Please Don't Include Us Workshop

Slide 30

نداء للمشاركة: لا تشملونا! ⚠️🚫

أحياناً "الشمولية" (Inclusion) اللي بننادي فيها بتكون هي المشكلة مش الحل.

ليش "لا تشملونا"؟

بعض الفئات المهمشة بتفضل إنها ما تنشمل في خوارزميات الـ AI عشان ما يتم استهدافها أو مضايقتها

بشكل أدق وأكثر ذكاءً.

الخلاصة: بناء AI عادل مش بس "كود"، هو فهم عميق للسياسة

والمجتمع وحقوق الإنسان. لازم نعرف متى "نضم" الناس ومتى "نتركهم بحالهم".